Η D-ική μας ματιά: Εξερευνώντας το Μέλλον του ΑΙ

Πώς όμως μέλλει να είναι το μέλλον της Τεχνητής Νοημοσύνης; Εσείς ρωτάτε… η D-News απαντά! Το παραπάνω βίντεο επιμελήθηκε ο μαθητής της Α’…

Περισσότερα

Η τεχνητή νοημοσύνη (Artificial Intelligence – AI) διατυπώθηκε ως όρος για πρώτη φορά στο Dartmouth College το 1956, σε συνέδριο ερευνητών από τους χώρους των Μαθηματικών, της Ηλεκτρονικής και της Ψυχολογίας για τη μελέτη των δυνατοτήτων χρήσης των υπολογιστών για την προσομοίωση της ανθρώπινης νοημοσύνης ([1]). Ωστόσο είχε ήδη κάνει την εμφάνισή της το 1950 στη μελέτη του Άγγλου μαθηματικού Άλαν Τούρινγκ (1912-1954) ο οποίος έθεσε το ερώτημα: «Μπορούν οι μηχανές να σκεφτούν;» ([2]). Το 1990, η τεχνητή νοημοσύνη ορίσθηκε από τον Kurzweil ως η τέχνη της δημιουργίας μηχανών που πραγματοποιούν λειτουργίες που απαιτούν νοημοσύνη όταν πραγματοποιούνται από τους ανθρώπους ([3]). Σήμερα η τεχνητή νοημοσύνη έχει επεκταθεί σε πολλούς τομείς και έννοιες – Machine Learning, Deep Learning, Cognitive Computing, Augmented Intelligence and Robotics κυριαρχούν στη ζωή μας.

Εικόνα 1 : Nέες δυνατότητες και Τεχνητή Νοημοσύνη

Η Τεχνητή Νοημοσύνη απαιτεί τη συλλογή και χρήση τεραστίου όγκου δεδομένων ώστε οι αλγόριθμοι της να εκπαιδευτούν και να αποδώσουν. Μέσα σ’ αυτά τα δεδομένα υπάρχουν και προσωπικά «ευαίσθητες» πληροφορίες όπως διευθύνσεις, οικονομικά στοιχεία και ιατρικές πληροφορίες ατόμων με αποτέλεσμα να εγείρονται ζητήματα φιλοσοφικά, ηθικά και δεοντολογικά. Στο παρόν άρθρο επισημαίνονται αυτοί οι κίνδυνοι και πως μπορεί η κοινωνία να προστατευθεί από αυτούς.

Η Τεχνητή Νοημοσύνη έχει εξελιχθεί σε ισχυρό εργαλείο για μία ποικιλία εφαρμογών σε πολλούς τομείς της ανθρώπινης ζωής.

Δήμοσια Ασφάλεια

Τα συστήματα επιτήρησης με τη χρήση Τεχνητής Νοημοσύνης βελτιώνουν τη δημόσια ασφάλεια ([4],[5]) αφού η αναγνώριση με βάση τα χαρακτηριστικά του προσώπου μπορεί να οδηγήσει σε εντοπισμό εγκληματιών αλλά και σε προγνωστική αστυνόμευση περιοχών συμβάλλοντας καθοριστικά στην αποτροπή μελλοντικών περιστατικών βίας. Επιπλέον η χρήση της τεχνολογίας αυτοματοποιεί τη διαδικασία παρακολούθησης και μειώνει την ανάγκη της ανθρώπινης επίβλεψης κάνοντας την πιο αξιόπιστη. Χαρακτηριστικό παράδειγμα περιοχής όπου χρησιμοποιείται το εν λόγω σύστημα για την επιβολή της δημόσιας τάξης σε μία ευρύτατη κλίμακα δεν είναι άλλο από την Κίνα, όπου μέσω παρόμοιων συστημάτων παρακολουθούνται οι κινήσεις των πολιτών, οι οποίοι αργότερα υπόκεινται σε ένα σύστημα “αξιολόγησης” της δημόσιας συμπεριφοράς τους.

Εικόνα 2 : Κάμερες και ιδιωτική ζωή

Εγείρονται όμως σημαντικές ανησυχίες για το απόρρητο και τις ατομικές ελευθερίες. Η δυνατότητα μαζικής παρακολούθησης ατόμων με τη χρήση τεχνητής νοημοσύνης χωρίς τη συγκατάθεσή τους και η συλλογή των ατομικών χαρακτηριστικών και καθημερινών συνηθειών τους αν και είναι σωτήρια για τη δημόσια ασφάλεια, παραβιάζει την προσωπική ελευθερία και την ιδιωτικότητα του ατόμου.

Κατά διαστήματα οι αντιδράσεις για την παραβίαση της ιδιωτικότητας μέσω της δημόσιας παρακολούθησης με τη χρήση καμερών έχουν φτάσει στο Ευρωπαϊκό Κοινοβούλιο με κύριο θέμα τη σωστή εφαρμογή του Ευρωπαϊκού Γενικού Κανονισμού Προστασίας Δεδομένων (Europe’s General Data Protection Regulation – GDPR) ([6]) που θεσπίστηκε από την ΕΕ τον Μάϊο του 2018 ([7]). Παρόλες τις πολλές διεξοδικές συζητήσεις και τη δημιουργία Επιτροπών, το ζήτημα εξακολουθεί να είναι μείζον και ανοικτό.

Υγεία

Η Τεχνητή Νοημοσύνη έχει κάνει τεράστια βήματα προόδου στον τομέα της Υγείας. Η συμβολή της στη ταχύτητα και στην ακρίβεια διάγνωσης είναι καταλυτική στη έγκαιρη διάγνωση των ασθενειών αλλά και στην επιλογή της κατάλληλης θεραπείας. Χαρακτηριστικό παράδειγμα είναι η χρήση αλγορίθμων Τεχνητής Νοημοσύνης στην ανάλυση Ιατρικών Απεικονίσεων (ακτίνες X, Μαγνητικός Τομογράφος) και στις πολύ κρίσιμες επεμβάσεις όπως αυτή στον εγκέφαλο ([8]).

Επίσης η συλλογή δεδομένων real-time του ασθενή (όπως παλμοί της καρδιάς, αρτηριακή πίεση) καθώς και η άμεση ανάλυσή τους από αλγορίθμους Τεχνητής Νοημοσύνης οδηγούν τους θεράποντες γιατρούς σε προγνωστική θεραπεία. Ετσι μπορεί να εφαρμοσθεί και η τηλεϊατρική που διευκολύνει ασθενείς σε απομακρυσμένες περιοχές να έχουν πρόσβαση σε υπηρεσίες υγείας χωρίς την ανάγκη μετακίνησης τους στα αστικά κέντρα.

Εικόνες 3α/3β : Tεχνητή Νοημοσύνη και Ιατρική — ChatGPT και Ρομποτική Ιατρική

Συνδυαστικά με τα παραπάνω, η εφαρμογή ChatGPT, που τυγχάνει μεγάλης αποδοχής από το ευρύ κοινό, δημιουργήθηκε με τη χρήση αλγορίθμων Τεχνητής Νοημοσύνης. Αποτελεί έναν εύκολο τρόπο για έγκαιρη αυτό-διάγνωση των συμπτωμάτων των ασθενειών. Θα πρέπει να τονιστεί ότι αυτή η εφαρμογή δεν μπορεί να υποκαταστήσει το γιατρό αφού αυτός συνεκτιμά και την κλινική εικόνα του ασθενούς – παράγοντας πολύ σημαντικός για την επιλογή της κατάλληλης θεραπείας.

Ψηφιακοί Προσωπικοί Βοηθοί

Τα τελευταία χρόνια οι Ψηφιακοί Βοηθοί που λειτουργούν με τη βοήθεια φωνής (Voice Based Digital Assistants – VDBA), όπως η Siri και η Alexa, έχουν ενσωματώσει στη λειτουργία τους την Τεχνητή Νοημοσύνη και έτσι μπορούν να εκτελούν πολύπλοκες λειτουργίες που απαιτούν την real-time επεξεργασία δεδομένων, προσαρμοσμένων όμως στο “αφεντικό” των Ψηφιακών Βοηθών ([9]). Για παράδειγμα αυτές οι συσκευές μπορούν να «κλείσουν» προσωπικά ραντεβού, να επιλέξουν μουσική με βάση προσωπικά κριτήρια και να ολοκληρώσουν μια παραγγελία στο super-market λαμβάνοντας υπόψη τις ανάγκες του σπιτιού. Για να μπορέσουν όμως να επιτελέσουν το σκοπό τους θα πρέπει να «γεμίσουν» με μεγάλο όγκο προσωπικών δεδομένων του “αφεντικού” τους τα οποία καταχωρούνται σε βάση δεδομένων επαναφέροντας το βασικό ζήτημα της ιδιωτικότητας. Δεν είναι λίγες οι φορές που αυτά τα δεδομένα αγοράζονται από διαφημιστικές εταιρείες παγκοσμίου βεληνεκούς, χωρίς φυσικά την έγκριση των ατόμων που περιλαμβάνονται σ’ αυτές, προκειμένου να μπορέσουν να «τρέξουν» στοχευμένες διαφημιστικές καμπάνιες.

Αναμφίβολα η συνύπαρξη Ηθικής και Τεχνητής Νοημοσύνης είναι μία σύνθετη διαδικασία και θα πρέπει να δοθεί ιδιαίτερη προσοχή από όλες τις Αρμόδιες Αρχές, όπως η Ευρωπαϊκή Επιτροπή, που ορίζουν το πλαίσιο λειτουργίας της κοινωνίας.

Η εφαρμογή σταθερού πλαισίου Ηθικών Αρχών είναι επιβεβλημένη. Η «αυτονομία» των ανθρώπων σε θέματα αποφάσεων θα πρέπει να υπερισχύει πάντοτε σε σχέση με την αυτονομία της Τεχνητής Νοημοσύνης και «super-system administrator» θα πρέπει να παραμένει ο άνθρωπος.

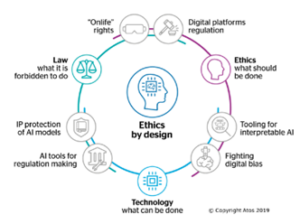

Στοχεύοντας προς αυτή την κατεύθυνση, η Ευρωπαϊκή Επιτροπή, επιπλέον της εισαγωγής του κανονισμού προσωπικών δεδομένων GDPR, ίδρυσε την Επιτροπή «High Level Expert Group on Artificial Intelligence (AI HLEG)», τον Απρίλιο του 2019, που διαμόρφωσε το πλαίσιο της Ηθικής που θα πρέπει να διέπει την Τεχνητή Νοημοσύνη για να είναι αξιόπιστη ([5]). Αυτό βασίζεται σε επτά χαρακτηριστικά:

Εικόνα 4: Πλάισιο Αποφάσεων στην Τεχνητή Νοημοσύνη (Εthics by Design)

Εικόνα 4: Πλάισιο Αποφάσεων στην Τεχνητή Νοημοσύνη (Εthics by Design)

Οι τεχνικές Machine Learning που χρησιμοποιούνται ευρέως και βασίζονται στην ιστορικότητα των γεγονότων και στην επανάληψή τους αλλά και οι τεχνικές «Deep Learning» που απαιτούν ακόμα περισσότερα προσωποποιημένα δεδομένα για να αποφασίσουν ανεξάρτητα από το παρελθόν θα πρέπει να δομηθούν έτσι ώστε η τελική απόφαση ιδιαίτερα σε κρίσιμα ζητήματα Ασφάλειας, Υγείας και Προσωπικότητας ΠΑΝΤΟΤΕ να λαμβάνεται από τον ανθρώπινο νου δεδομένου ότι μόνο αυτός μπορεί να θέσει το ζήτημα της Ηθικής σε πρώτη προτεραιότητα. Στην Εικόνα 4 παρουσιάζεται το πλαίσιο σχεδιασμού λήψης Ηθικών αποφάσεων όπως αυτό προτείνεται από την European Emergency Number Association (EENA) ([5]).

Μιχαήλ-Ιωάννης Δάλλας

Μαθητής Α’ Λυκείου

ΒΙΒΛΙΟΓΡΑΦΙΚΕΣ ΑΝΑΦΟΡΕΣ

Πώς όμως μέλλει να είναι το μέλλον της Τεχνητής Νοημοσύνης; Εσείς ρωτάτε… η D-News απαντά! Το παραπάνω βίντεο επιμελήθηκε ο μαθητής της Α’…

Περισσότερα

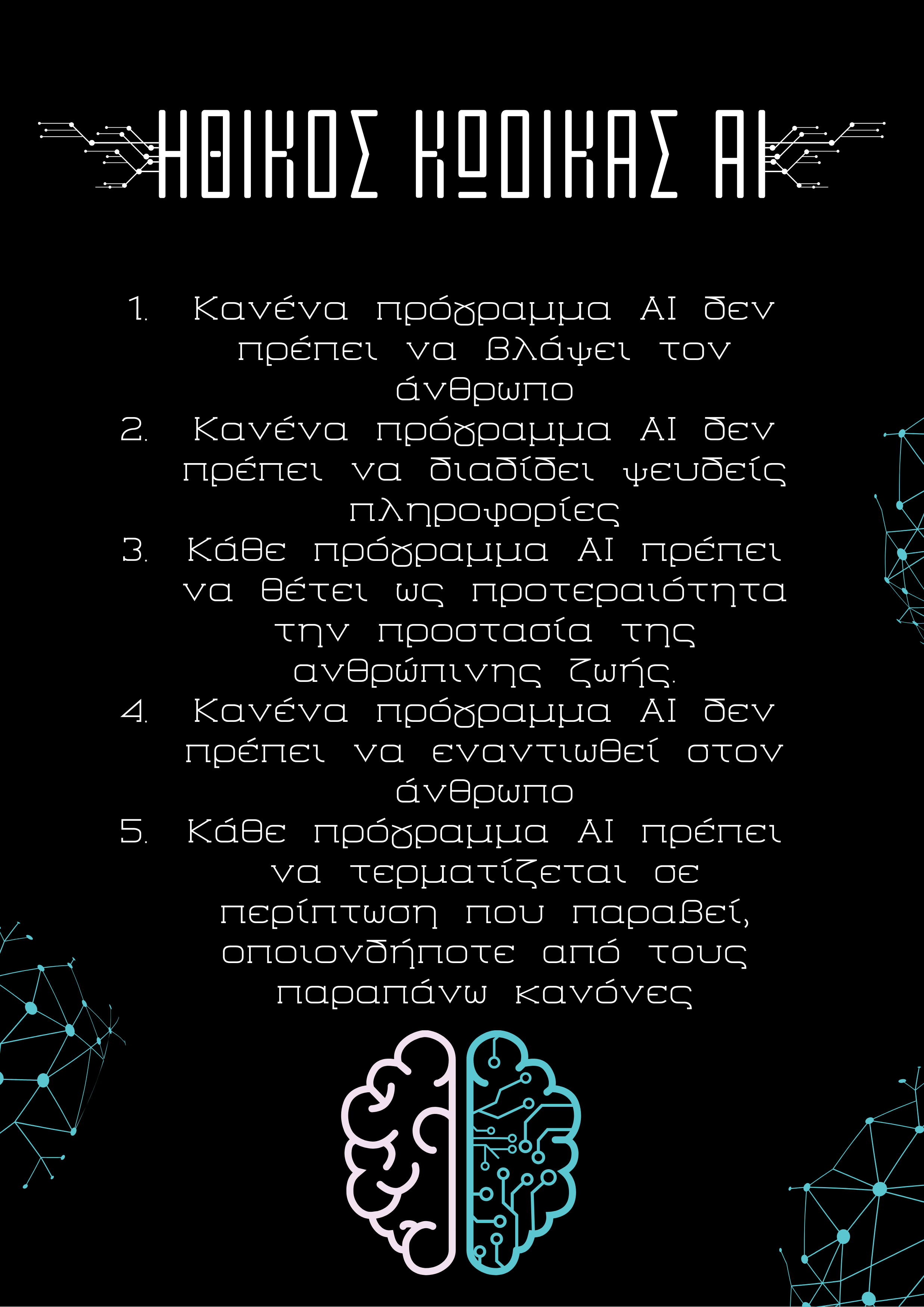

Λαμβάνοντας ως εναρκτήριο λάκτισμα τους τρεις νόμους της ρομποτικής του Ισαάκ Ασίμωφ, η D-News αποφάσισε να ολοκληρώσει το αφιέρωμά της για την Τεχνητή…

Περισσότερα

D-News… strikes again! This time with an in-depth analysis of various aspects of Artificial Intelligence ethics by Mr. John Gougoulis, who is not only…

Περισσότερα